Fusión multisensor de AGV (vehículo guiado automático) para tecnología de evitación de obstáculos en tiempo real

I Introducción del sistema de evitación de obstáculos en tiempo real con fusión multisensor AGV

1. Introducción

La tecnología de fusión de sensores es clave para que los robots logren una cobertura total para evitar obstáculos. Su principio se basa en el procesamiento integrado de la información por parte del cerebro humano: al coordinar múltiples sensores (p. ej., LIDAR, cámaras de visión, etc.) para la integración de información multinivel y multidimensional, se compensan las limitaciones de un solo sensor y, en última instancia, se genera una percepción consistente del entorno. Esta tecnología integra las ventajas complementarias de los datos de múltiples fuentes (p. ej., medición precisa de distancias y reconocimiento de objetos) y optimiza el flujo de procesamiento de la información mediante algoritmos inteligentes, de modo que los AGV pueden mejorar simultáneamente la precisión para evitar obstáculos y la adaptabilidad ambiental en entornos dinámicos complejos.

2. Mejorar la precisión de la detección

Integración de LiDAR (medición de distancia precisa, pero el deslumbramiento es fácil de interferir), visión (identificación del tipo de objeto, la poca luz es limitada) y ultrasónico (detección de zona ciega a corta distancia) y otros datos de múltiples sensores, deficiencias complementarias, para mejorar la precisión de la identificación de obstáculos.

3. Mayor confiabilidad del sistema

El diseño redundante garantiza que cuando falla un solo sensor (por ejemplo, falla LIDAR), otros sensores aún pueden mantener la evitación de obstáculos; combinado con el filtrado de Kalman y otros algoritmos, se filtra la interferencia de ruido para mejorar la estabilidad de los datos.

4. Adaptabilidad ambiental extendida

Sensores de conmutación dinámica ventajosos para tratar escenas complejas, como interferencias electromagnéticas cuando se eligen datos antiinterferencias, fusión de entornos de humo de ultrasonidos y LiDAR, y para obstáculos transparentes o salientes para habilitar sensores infrarrojos y otros especiales.

5. Optimizar la toma de decisiones para evitar obstáculos

A través de la detección de particiones de múltiples sensores (por ejemplo, delineando zonas de evitación de obstáculos/desvío en el frente), integrando la distancia del obstáculo (LIDAR), el tipo (visión) y la información de proximidad (ultrasónica), generando un modelo de entorno global y planificando con precisión la ruta óptima.

II Principio de evitación de obstáculos por fusión multisensor

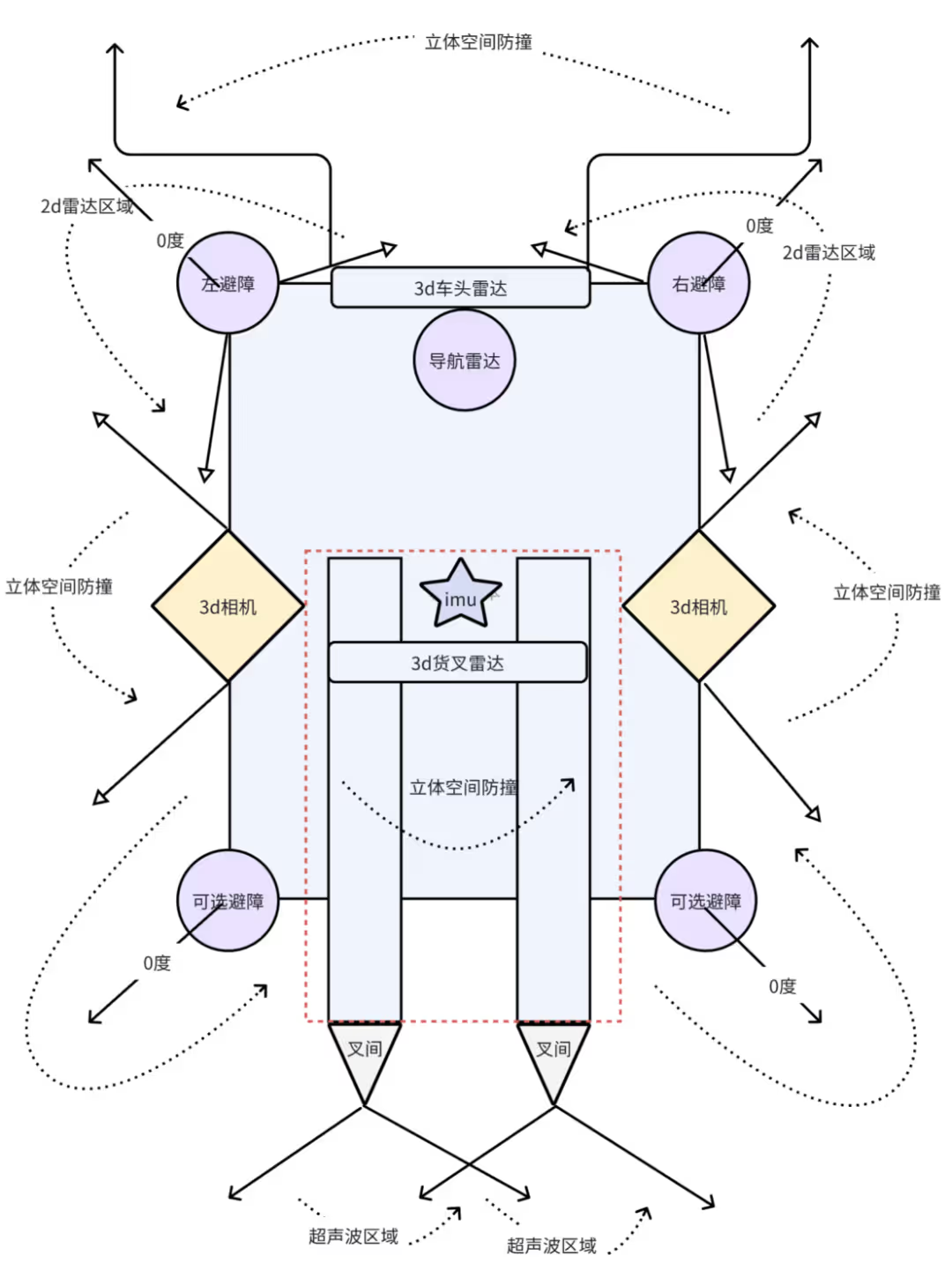

1. Disposición típica

- Prevención de obstáculos principales frontales: escaneo láser 2D izquierdo y derecho de obstáculos horizontalmente, detección de obstáculos bajos suplementaria ultrasónica inferior, láser 3D oblicuo superior frontal que cubre el espacio tridimensional.

- Protección lateral: Cámaras de profundidad montadas inclinadas en ambos lados para eliminar el punto ciego lateral del AGV.

- Prevención de colisiones de horquilla: la horquilla está equipada con una IMU para monitorear la actitud en tiempo real, combinada con datos láser 3D superiores e inferiores para predecir dinámicamente la trayectoria de la horquilla y proteger el área circundante.

- Prevención de colisiones entre horquillas: dos sensores ultrasónicos controlan los obstáculos en el área del sector a ambos lados de la parte trasera del vehículo.

2. Métodos de fusión

- Nivel de datos: unifique las marcas de tiempo y los sistemas de coordenadas de múltiples sensores y fusione los datos de la nube de puntos directamente.

- Nivel de característica : Fusión de características de borde LiDAR con características SIFT visuales, aprendizaje profundo utilizando PointNet++ (nube de puntos) y CNN (imagen), o generación de mapas de probabilidad de obstáculos a través de EKF.

- Nivel de decisión: la red bayesiana pondera dinámicamente la confianza de cada sensor, los ultrasonidos activan paradas de emergencia en escenarios de emergencia y el LiDAR planifica rutas de desvío.

3. Detección del entorno

- División del trabajo a distancia y cerca: la nube de puntos de radar 3D detecta obstáculos globales en el extremo más alejado y la cámara de profundidad identifica obstáculos locales en el extremo más cercano.

- Definición de obstáculo: incluye personas, mercancías, carretillas elevadoras y otros objetos con volumen, el proceso central es “detección → seguimiento → localización” (confirmación de existencia → predicción de trayectoria → cálculo de distancia).

- Mapa semántico: etiquetado de categorías de obstáculos (por ejemplo, estantes, ascensores) a través de la segmentación de instancias, extracción de contornos y mapeo de los mismos en el mapa para respaldar la toma de decisiones inteligente para evitar obstáculos.

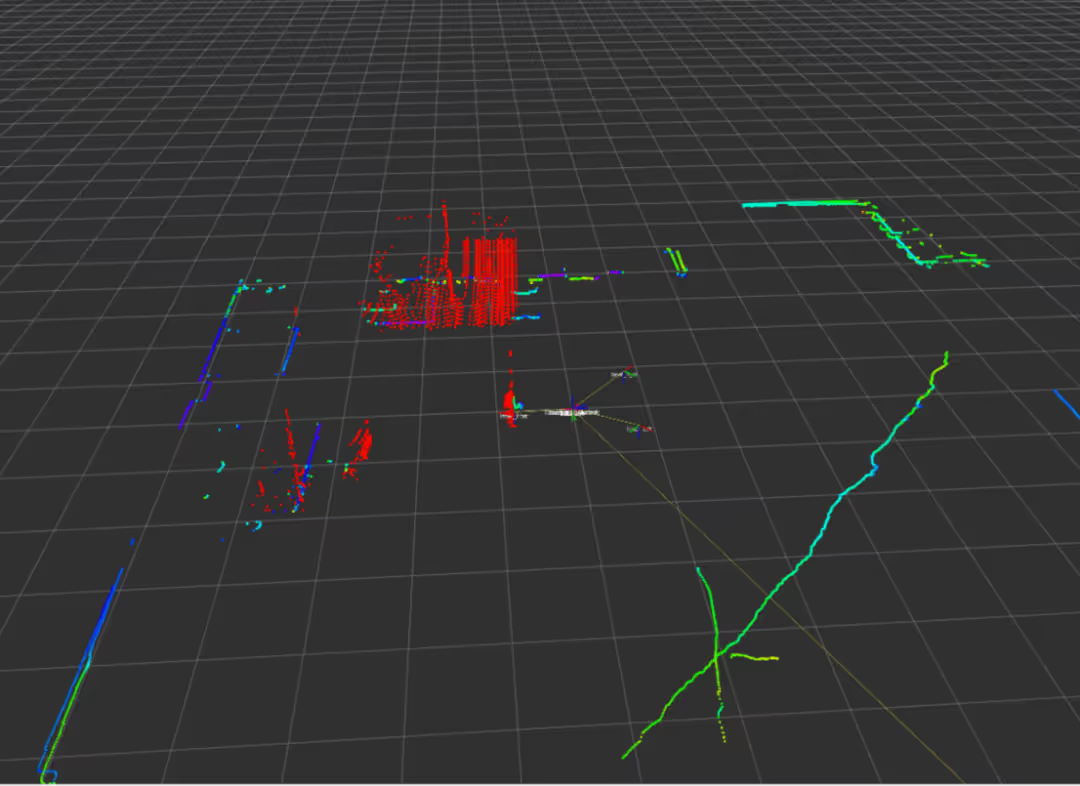

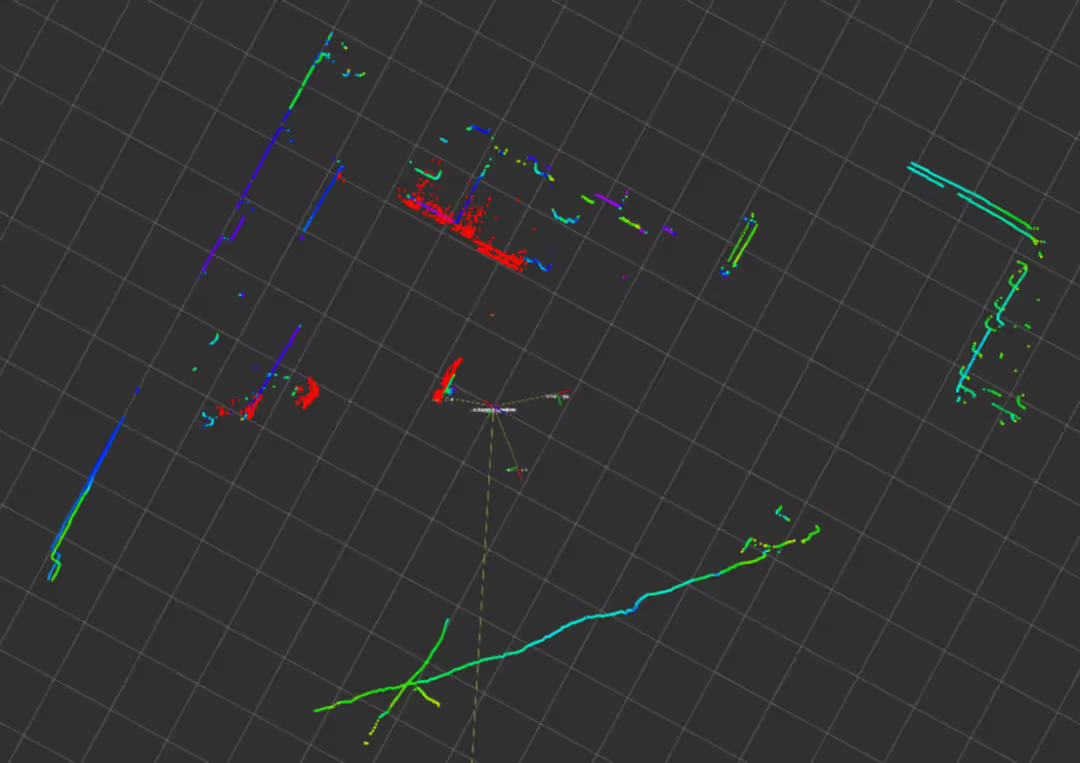

- Proceso de evitación de obstáculos globales: para el problema de los datos de nubes de puntos grandes y ruidosos, primero se llevan a cabo el filtrado y el muestreo descendente; después de segmentar la nube de puntos del suelo, los grupos de obstáculos del suelo se segmentan mediante un algoritmo de agrupamiento y los atributos como el centro/la dimensión se ajustan al marco circundante; combinado con el marco de detección de objetivos de la nube de puntos (por ejemplo, PointPillar), se llevan a cabo la anotación semántica y el seguimiento, y se construye un filtro Kalman para suavizar la trayectoria, y se realiza una optimización simultánea de la aritmética para garantizar el procesamiento en tiempo real; se requiere compensación y corrección cuando existe distorsión de movimiento. tiempo real; se requiere corrección de compensación cuando existe distorsión de movimiento.

4. Algoritmo de evitación de obstáculos en tiempo real

- Prevención de obstáculos locales: la cámara de profundidad cubre el área periférica cercana del cuerpo, la IMU de horquilla proporciona información en tiempo real del ángulo de actitud y el sensor inferior monitorea los obstáculos espaciales.

- Replanificación de ruta: basada en la velocidad del AGV (ciclo de 100 a 200 ms), muestreo de trayectoria factible a través del método de ventana dinámica, predicción de la tendencia de movimiento de obstáculos dinámicos, ruta de optimización en tiempo real.

- Asistencia de aprendizaje de refuerzo: combinada con DQN, PPO y otros algoritmos, entrena al AGV para adaptarse a la escena dinámica compleja en el entorno de simulación para mejorar la capacidad de toma de decisiones autónoma.

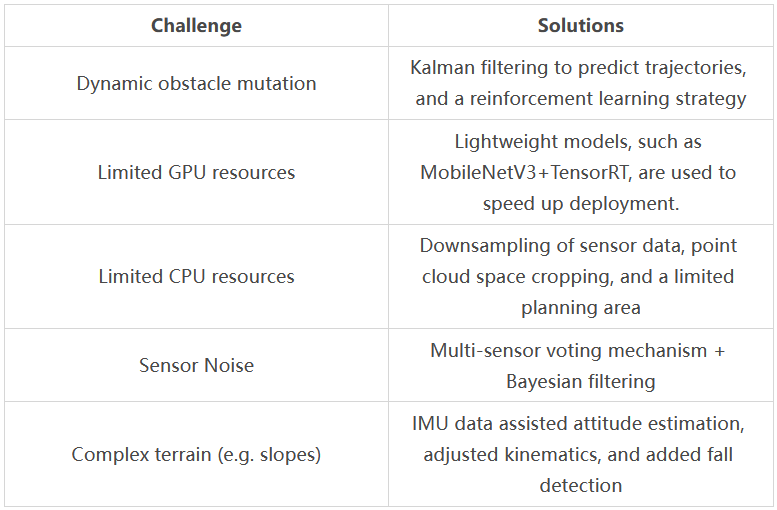

III Desafíos y futuro de la evitación de obstáculos con fusión multisensorial

1. Escenarios de aplicación de la evitación de obstáculos con AGV

Las aplicaciones prácticas de evitación de obstáculos con AGV suelen presentar dificultades. A continuación, se enumeran los desafíos y las soluciones:

2. Direcciones futuras

- Estrategias biónicas: imitar el comportamiento de una colonia de hormigas o un enjambre de aves para predecir trayectorias de obstáculos dinámicos.

- Fusión neuronal: modelos de extremo a extremo (por ejemplo, PointNet+++Transformer) para procesar directamente datos LiDAR y de visión.

- Arquitecturas similares a cerebros: redes neuronales de impulsos (SNN) para toma de decisiones de bajo consumo, mecanismos LSTM+atención para predecir el movimiento de obstáculos en series temporales largas.

- Co-computación: procesamiento en capas de extremo a extremo de la nube para reducir la presión aritmética integrada.

- Migración de simulación: aleatorización de dominios para una mejor generalización, ajuste fino en línea y en tiempo real de modelos (por ejemplo, Meta-RL).

- Inteligencia poblacional: aprendizaje federado para optimizar rutas de múltiples AGV, teoría de juegos para coordinar dinámicamente el derecho de paso.

- Objetivo: Construir un sistema inteligente de 'detección-decisión-control', a través de algoritmos bioinspirados, colaboración entre dominios (V2X/gemelo digital) y hardware energéticamente eficiente, para lograr capacidades de conducción similares a las humanas en entornos complejos, teniendo en cuenta la seguridad, la eficiencia y la ética.

Suscríbase a AiTEN Robotics para obtener más contenido técnico.

_%E7%94%BB%E6%9D%BF%201.avif)